CERNがAIをシリコンに焼き込む理由──50ナノ秒の取捨選択

宇宙の設計図を読み解くために、CERNは「巨大なAI」ではなく「極小のAI」を選んだ。捨てるデータの見極めこそが、発見への最短距離だ。

宇宙の設計図を読み解くために、CERNは「巨大なAI」ではなく「極小のAI」を選んだ。捨てるデータの見極めこそが、発見への最短距離だ。

毎秒1ペタバイトの洪水

大型ハドロン衝突型加速器(LHC)が年間に生み出す未フィルタのセンサーデータは、約4万エクサバイト。インターネット全体のおよそ4分の1に相当する規模だ。

ETHチューリッヒの素粒子物理学者テア・アールレスタッド(今月、同大学の助教に就任)は、今月開催されたバーチャルカンファレンスMonster Scale Summitで、この途方もないデータとの格闘について語った。保存して分析できるのは全体の0.02%未満。残りの99.98%は、生まれた瞬間に永遠に失われる。

LHCの検出器はGoogleやNetflixとは次元の違うリアルタイム処理を要求される。毎秒数百テラバイトのストリーミングデータを受け取り、保存するか捨てるかの判断を下す猶予は、わずか数マイクロ秒。そのバッファを超えた瞬間、データは「崖から落ちる」ようにして消える。

スイスとフランスの国境地下100メートルに設置された全長27キロのリングの中で、陽子はほぼ光速で周回している。25ナノ秒間隔で約2,800の陽子束が走り、衝突ごとに数メガバイトのデータが生じる。毎秒約10億回の衝突が起きているのだ。

この規模の問題を地上のサーバーに丸投げするのは物理的に不可能だった。CERNが選んだ解は、検出器の直下に巨大なエッジコンピューティングシステムを構築することだった。

50ナノ秒で「未知」を見つける

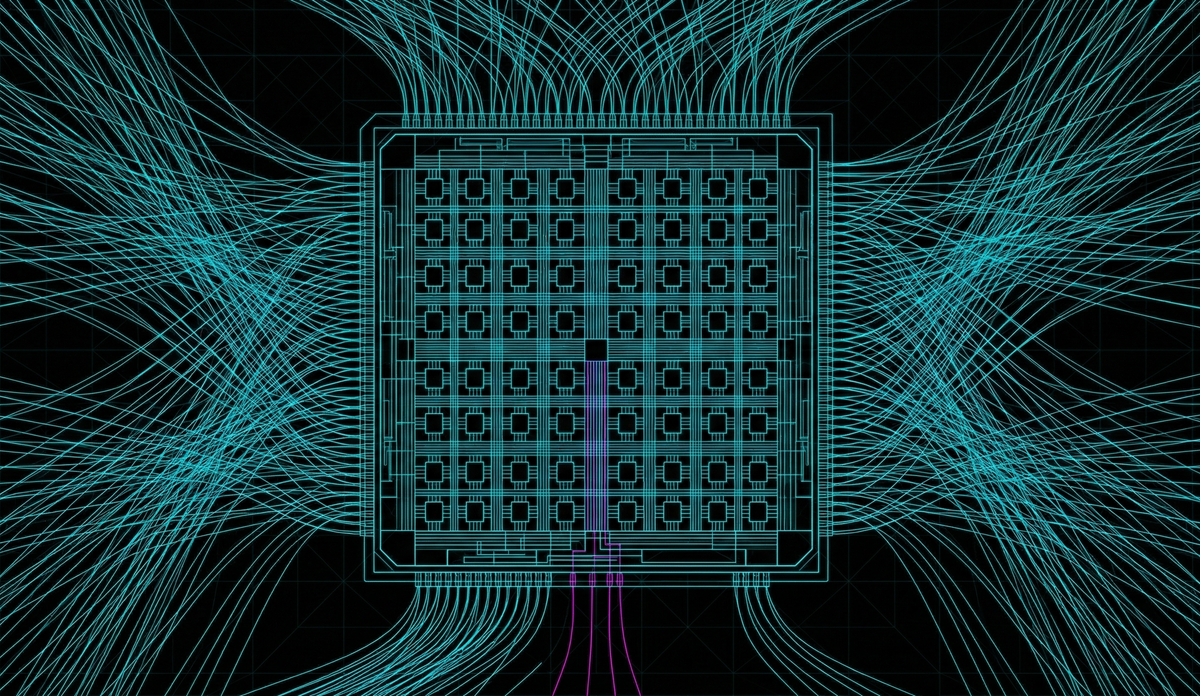

データの取捨選択を担うのが「レベル1トリガー」と呼ばれるシステムだ。約1,000基のFPGA(書き換え可能な集積回路)で構成され、光ファイバー経由で毎秒約10テラバイトのデータを受け取る。

その中核に座るのが AXOL1TL(Anomaly eXtraction Online Level-1 Trigger aLgorithm)という異常検知アルゴリズムだ。変分オートエンコーダ(VAE)をベースにした教師なし学習モデルで、標準模型の「既知の背景」を学習している。衝突データがその背景から外れたとき──つまり「未知の物理」の兆候を示したとき──だけ「保存」の判定を下す。

判定にかけられる時間は50ナノ秒。人間が瞬きするのに約3億ナノ秒かかることを考えると、その速度の異常さがわかる。しかも99.7%以上を棄却し、毎秒約11万件だけを選び抜く精度が求められる。

CMS実験のレベル1トリガーにAXOL1TLが統合されたのは2024年5月のことだ。すでに実データでの運用が始まっており、従来のルールベースのトリガーでは拾えなかったイベントを選別できることが確認されている。

地上に送られたデータはさらに「ハイレベルトリガー」で二次選別される。2万5,600基のCPUと400基のGPUが、毎秒10万件から約1,000件の「本当に面白い衝突」だけを抽出する。最終的に保存されるのは1日あたり約1ペタバイト。このデータが42カ国170拠点の研究者に配信される。

AIを「小さく焼く」技術

ここで際立つのは、CERNのAI開発が商用AIとまったく逆方向を向いていることだ。

OpenAIやGoogleが数千億パラメータのモデルを汎用GPUの巨大クラスタで動かす一方、CERNは最初から 「極限まで小さいモデル」 を設計する。量子化、枝刈り、蒸留を前提にモデルを構築し、FPGA上のすべての演算を固定小数点化する。パラメータごとに異なるビット幅を定義し、勾配降下法で最適化できるよう微分可能にする。

この一連の工程を支えるのが、オープンソースのトランスパイラ hls4ml だ。KerasやPyTorchで学習したモデルをC++のHLS(高位合成)コードに変換し、FPGAやASICに直接書き込める。文字通り「AIをシリコンに焼き込む」ツールであり、量子コンピューティングの制御系や自動運転車、宇宙探査の衛星にも応用が広がっている。

さらに興味深いのは、CERNの経験では深層学習モデルよりも決定木ベースのモデルのほうが同等の性能をはるかに低コストで実現できるという知見だ。標準模型の衝突データは本質的に「構造化された表形式データ」であり、巨大なTransformerモデルが必ずしも最適解ではないことをCERNは実証している。

ノイマン型のメモリ-プロセッサ分離アーキテクチャはここでは通用しない。すべての判断はチップ上で完結しなければならず、高速メモリへの受け渡しすら許されない。入力に対する全出力をルックアップテーブルに事前計算し、データが到達した瞬間に次の処理が始まる。

「捨てる技術」の先にある発見

そして先週、LHCはこのシステムが機能していることを改めて証明した。LHCb実験チームが新粒子Ξcc⁺(クサイ・シーシー・プラス)を発見したのだ。陽子と同じバリオンだが、2つのアップクォークをチャームクォークに置き換えた、質量が約4倍の「重い陽子」だ。

LHCが発見したハドロンはこれで80個目。20年以上未確認だった粒子の存在を7シグマの統計的確度で確定させた。

この発見は、CERNの哲学そのものの成果だろう。1兆回に1回しか起きないプロセスを捉えるために、残りの9999億9999万9999回を正確に捨てる。「何を保存するか」ではなく「何を捨てるか」の精度が、科学の突破口を開いている。

2030年への助走

LHCは2026年7月に第3期ロングシャットダウン(LS3)に入る。次世代の高輝度LHC(HL-LHC)への改修が始まり、2030年6月に最初のビームが走る予定だ。

HL-LHCでは衝突頻度が現在の10倍に跳ね上がり、検出器が処理するデータ量は毎秒4テラビットから63テラビットへと急増する。イベントサイズも2MBから8MBに膨らむ。CERNのエンジニアたちは今、この「10倍のデータ洪水」に耐える次世代のトリガーシステムを設計している。

シリコンバレーが「より大きく、より汎用的なAI」に向かって走る中、CERNはまったく逆の方向で限界を押し広げている。モデルを極限まで削ぎ落とし、ナノ秒単位でシリコンに判断を刻み込む。宇宙の成り立ちを理解するために必要なのは、すべてを記憶することではなく、何を忘れるべきかを知ることなのかもしれない。

#CERN #LHC #機械学習 #FPGA #素粒子物理学 #AI #hls4ml