Copilot「娯楽目的限定」——MS利用規約が語る矛盾

あれほど業務活用を推進してきたAIアシスタントが、法的には「遊び」扱いだった。利用規約に刻まれた一文が、いまテック業界に波紋を広げている。

あれほど業務活用を推進してきたAIアシスタントが、法的には「遊び」扱いだった。利用規約に刻まれた一文が、いまテック業界に波紋を広げている。

Copilot利用規約に書かれた衝撃の一文

Microsoftが公開しているCopilotの個人向け利用規約に、見過ごせない記述がある。「重要な開示と警告」セクションに太字で記されたその一文は、こうだ。

「Copilotは娯楽目的限定です。間違いを犯すことがあり、意図したとおりに動作しない可能性があります。重要な助言をCopilotに頼らないでください。自己責任で利用してください」

この規約は2025年10月24日に更新されたもので、Copilotアプリ、copilot.microsoft.comでのサービス、さらには「他のMicrosoftアプリやWebサイトを通じたCopilotとの会話」にも適用される。つまり、Windowsに統合されたCopilot体験のほとんどが、法的には「娯楽」の範囲内というわけだ。

ただし一点、注意が必要な区分がある。規約には「Microsoft 365 Copilotのアプリやサービスには、そのアプリが本規約の適用を明示しない限り適用されない」とも書かれている。企業向けの有料サービスと、個人向けの無料Copilotでは法的な建て付けが異なる可能性がある。

・ ・ ・

広告では「生産性革命」、規約では「娯楽」

この矛盾を理解するには、Microsoftが過去2年間にやってきたことを振り返る必要がある。

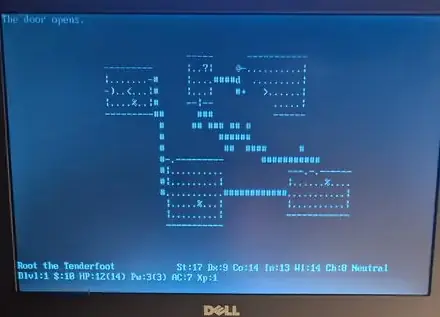

| 広告・マーケティング | 利用規約(2025年10月改定) | |

|---|---|---|

| 製品の定義 | パーソナルAI コンパニオン | 娯楽目的限定 |

| 想定用途 | ビジネス戦略の立案 業務の生産性向上 | 重要な助言に 頼らないこと |

| 出力の保証 | 仕事を変える 頼れるパートナー | いかなる保証も 表明もしない |

| エラー責任 | — | 全てユーザーの 自己責任 |

| 知的財産 | — | 著作権・商標・ プライバシー侵害の 保証なし |

| 免責義務 | — | ユーザーがMSを 補償する義務あり |

出典:Microsoft Copilot Terms of Use(2025年10月24日改定版)。広告・マーケティング欄はMicrosoft公式サイトおよびCopilot+ PC販促資料に基づく

同社はCopilot+ PCという新カテゴリを打ち立て、キーボードに専用のCopilotキーを搭載し、WindowsのタスクバーにCopilotを常駐させた。CopilotをWord、Excel、Teams、Edge、Bingと——ありとあらゆる製品に統合してきた。

マーケティングでは「ビジネス戦略を一緒に考える頼れるパートナー」として描き、利用規約では「娯楽です、信じないでください」と書く。この温度差は、控えめに言って誠実とは言い難い。

AI基盤への投資は800億ドル(約12兆7700億円)規模に達し、OpenAIへの出資だけでも130億ドル超(約2兆800億円)を費やしている。これだけの金額を「娯楽」に注ぎ込んでいるとすれば、史上最も高価なエンターテインメントだ。

Xではこの話題が急速に拡散した。あるユーザーは「Fortune 500企業のCIOに生産性の倍増装置として売り込んだのと同じ製品が、利用規約では娯楽用だと?」と投稿し、多くの反響を呼んでいる。

もっともな怒りだ。しかし、もう少し冷静に構造を見てみたい。

法務部門が書いた「保険」の正体

この種の免責条項は、実はMicrosoftだけのものではない。xAIはGrokの利用規約で「AIは確率的な性質を持ち、ハルシネーションを含む出力を生成する可能性がある」と明記している。ChatGPTもGeminiも、程度の差はあれ似たような警告を載せている。

だが「娯楽目的限定」という表現は、他社の免責とは次元が違う。「間違うかもしれません」と「遊びにしか使えません」の間には、法的に重大な距離がある。前者は注意喚起だが、後者は用途そのものの制限だ。

Hacker Newsでは開発者から辛辣な反応が相次いだ。「弁護士たちが会議室に集まって、呪文を唱えながらこの"免罪カード"を作り出している光景が目に浮かぶ」という声や、「Copilot is for entertainment purposesのステッカーを作って、職場でCopilotを押し付けてくる人全員に配りたい」という声もある。

技術的に興味深いのは、この規約が「他のMicrosoftアプリやWebサイトを通じた会話」にも適用される点だ。Windows 11のシステムに統合されたCopilot体験の多くが、この免責の傘の下に入る可能性がある。

法務の視点で見れば、これは賢い防御策だ。AIの出力に基づいて損害を被ったユーザーが訴訟を起こしたとき、「規約に娯楽限定と書いてありましたよね」と言える。だが、製品の売り方との乖離が大きくなるほど、その防御壁は逆に企業の信頼性を侵食する。

・ ・ ・

問題の本質は「二枚舌」の構造にある

この問題はCopilotだけの話ではない。AI業界全体に共通する構造的な矛盾が、ここに凝縮されている。

マーケティング部門は「AIが仕事を変える」と叫び、法務部門は「何も保証しない」と書く。営業チームは企業のCIOにCopilotの導入を勧め、利用規約は「重要な判断に使うな」と警告する。Microsoftは2026年2月時点で4億5000万のユーザーベースに対し、わずか1500万席しかCopilotの有料契約を獲得できていないと報じられた。巨額の投資に対して回収が追いついていない焦りが、マーケティングの熱量と法的な慎重さの落差をさらに広げている。

サイバーセキュリティの観点からも、この免責条項は無視できない。Copilotで生成したコードに脆弱性があっても、契約書を作成して法的に問題があっても、顧客対応文書に誤りがあっても——すべてユーザーの自己責任だ。規約にはこうも書かれている。「Copilotの出力を公開・共有した場合、その責任はすべてあなたにあります」。

ユーザーが取るべき姿勢

では、私たちはCopilotをどう扱えばいいのか。

答えは実はシンプルだ。AIの出力はあくまで「下書き」として扱い、最終判断は人間がする。これはCopilotに限らず、ChatGPTでもGeminiでもClaudeでも同じことだ。AIが自信満々に提示する情報ほど、裏取りの重要性は高まる。

皮肉なのは、Microsoftの法務チームが書いたこの免責条項こそが、ある意味で最も誠実なAIリテラシー教材だということだ。「信じるな、確認しろ」——この原則さえ守れば、AIは確かに強力なツールになる。

問題は、その原則を最も声高に教えるべき立場のMicrosoftが、マーケティングでは正反対のメッセージを送り続けていることだ。

広告と規約のどちらがMicrosoftの本音なのか。答えは、利用規約を読めばわかる。企業の本音は、いつだって法務部門の文書に宿る。

参照元

関連記事

- EdgeがPC起動時に自動で開くようになる――Microsoftが新機能をテスト中

- 英国CMA、Microsoftの業務ソフト帝国にメスを入れる

- GitHub Copilot、PR広告を即日撤回──残る150万件の不信

- GitHub Copilotがプルリクエストに広告を混入──1万1000件超のコード汚染が発覚

- Windows 11の検索、ようやく「本来の仕事」を取り戻すのか

- AIチャットボットは「賢い検索エンジン」ではない──誤情報が訂正されても消えない構造的な理由

- Microsoft日本に100億ドル──巨額AI投資の裏側

- Reddit最大のプログラミング板がLLM話題を全面禁止

- Windows 11、24H2ユーザーに25H2への強制アップデートを開始

- マイクロソフト、自社AIモデル3種でOpenAI依存脱却へ