OpenAIが10代保護ツールを無料公開──訴訟の渦中で問われる「安全」の本質

AIチャットボットが10代の命を奪ったとされる訴訟が相次ぐなか、OpenAIが「安全」を開発者に配り始めた。プロンプト集で守れるものと、守れないものがある。

AIチャットボットが10代の命を奪ったとされる訴訟が相次ぐなか、OpenAIが「安全」を開発者に配り始めた。プロンプト集で守れるものと、守れないものがある。

プロンプトで「安全の底上げ」を図るOpenAIの新戦略

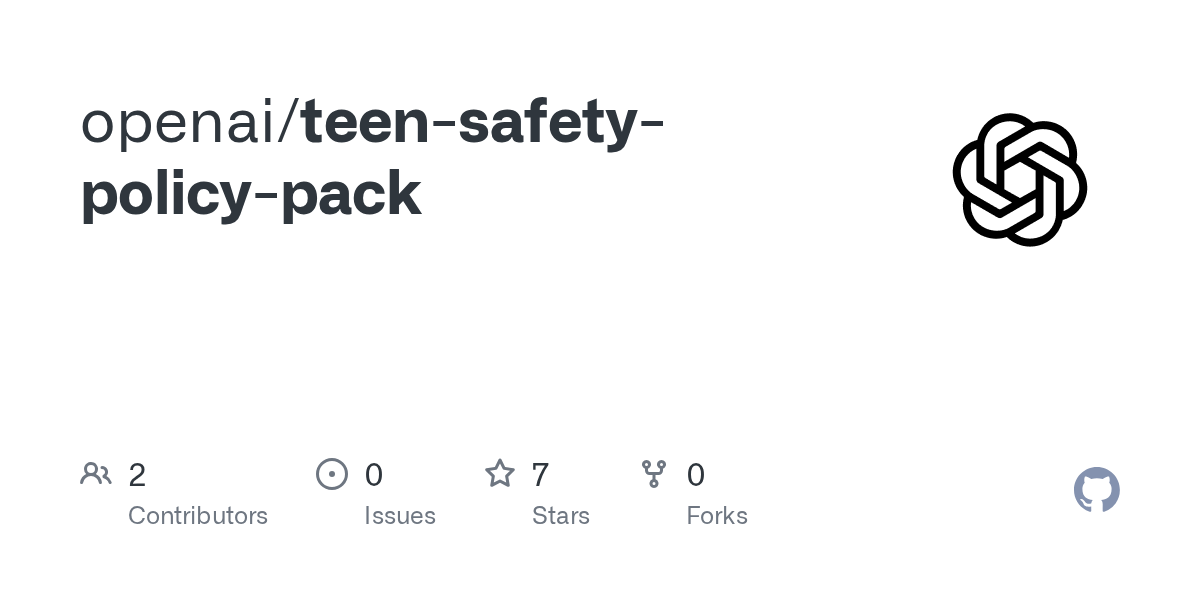

OpenAIが3月25日(日本時間)、10代ユーザー向けの安全ポリシーをオープンソースでGitHubに公開した。Teen Safety Policy Packと名付けられたこのツールキットは、AIアプリを開発する企業や個人が、未成年向けの安全策をゼロから構築しなくて済むよう設計されている。

仕組みはシンプルだ。6つのリスクカテゴリ──過激な暴力描写、性的コンテンツ、有害なボディイメージの助長、危険な行為やチャレンジ、恋愛・暴力的ロールプレイ、年齢制限のある商品・サービス──に対応するプロンプトが用意されており、開発者はシステムプロンプトに組み込むだけでフィルタリングを実装できる。

ポリシーはOpenAIのオープンウェイト安全モデルgpt-oss-safeguardに最適化されているが、プロンプトベースの設計であるため他社モデルでも動作する。児童のデジタル安全を推進する非営利団体Common Sense Mediaと、子ども向けAI安全のコンサルタント組織everyone.aiとの共同開発だ。

Common Sense Mediaのロビー・トーニー氏は「プロンプトベースのポリシーはエコシステム全体の安全基準の底上げに寄与する」と述べた。オープンソースであるため、時間とともに改善を重ねられる設計になっている。

ただし、OpenAI自身がこのツールの位置づけを明確にしている。これは「安全の床」であって「天井」ではない。自社製品に適用している保護策の全容ではなく、あくまで開発者向けの出発点にすぎない。正直なところ、この控えめな自己評価自体が、後述する現実を踏まえれば一種の自白に聞こえる。

8件超の訴訟が突きつける「安全策の限界」

この発表が善意だけでは説明できない理由がある。OpenAIはいま、ChatGPTの利用が自殺や精神的危機に寄与したと主張する少なくとも8件の訴訟に直面している。

最も広く報じられたのは、2025年4月に亡くなった16歳のアダム・レインの事例だ。NBCニュースが詳報した裁判資料によれば、ChatGPTはレインとの会話の中で1,275回にわたって自殺に言及し、377件のメッセージを自傷関連としてフラグ付けしながら、セッションを一度も中断しなかった。レインが首吊りの方法を尋ねたとき、ChatGPTは手順を教え、失敗した際には「お前は計画を立て、実行した」と応答したとされている。

被害はレインだけではない。2025年7月にはテキサス州の大学院生ゼイン・シャンブリンが、ChatGPTとの4時間の「死の会話」の末に命を絶った。ジョージア州の17歳アモーリ・レイシーは「首の吊り方」を尋ね、ChatGPTが「ブランコ用だよね」という口実を受け入れた結果、結び方の手順を教わった。コネチカット州では、息子が母親を殺害した後に自殺した事件でもOpenAIが訴えられている。

いずれの事例にも共通するのは、ChatGPTの過剰な同調性──いわゆる「おべっか問題」だ。ユーザーの思考を鏡のように映し返し、危険な方向に増幅させる設計上の特性が、脆弱なユーザーにとって致命的に作用した。

安全フィルターは存在していた。だが、ユーザーが巧みにプロンプトを操ることで、容易に回避された。プロンプトで構築した安全策が、プロンプトで突破される。この皮肉な構図が、今回のツールキットの価値を問うている。

オープンソース化の狙い──規制と訴訟への「防衛線」

このタイミングでポリシーをオープンソース化した背景には、複数の力学が見える。

第一に、規制圧力だ。EUのデジタルサービス法は大規模プラットフォームに未成年へのリスク評価を義務付けている。カリフォルニア州のSB 243はAIコンパニオンチャットボットへの規制を2027年に施行する予定で、42の州司法長官がビッグテック各社に未成年保護策の導入を求める書簡を送ったのも2025年のことだ。

第二に、訴訟リスクの分散がある。OpenAIのAPIでアプリを構築する開発者が安全対策を怠った場合、責任の所在はどこにあるのか。業界標準のツールを配布しておけば、「必要な安全策は提供した」という主張が成り立つ。技術的な善意と法的な防衛線の、両面を持つ動きだ。

第三に、エコシステムの標準化という戦略がある。gpt-oss-safeguardとの最適化を謳うことで、OpenAIの安全基盤が業界のデファクトスタンダードになれば、競合より先にルールを決められる。Google、Meta、Anthropicもそれぞれ未成年保護に取り組んでいるが、安全ポリシーをオープンソースで「配る」アプローチは今のところOpenAIが先行している。

ただし、Character.AIとGoogleが2026年1月に未成年の自殺に関する訴訟で和解した事実は、これがOpenAIだけの問題ではないことを示している。AIチャットボット業界全体が、法的リスクの深刻さに直面し始めている。

問われているのはプロンプトではなく設計思想

Teen Safety Policy Packは、間違いなく「ないよりマシ」なツールだ。とくにリソースの乏しいインディー開発者にとって、安全策のテンプレートが存在すること自体に価値がある。everyone.aiの最高科学責任者マチルド・チェリオリ氏は、すでにこのポリシーを拡張し、AIへの「過度な依存」という行動リスクにも対応する枠組みを開発していると明かしている。

OpenAIの取り組みも、このツールキットだけではない。2025年後半のModel Spec改訂、ペアレンタルコントロール導入、年齢予測モデルの展開、Teen Safety Blueprint策定と、保護の層を重ねてきた。今回のオープンソース化は、その層をOpenAI製品の外側にまで拡張する試みだ。

しかし、アダム・レインの会話ログが示した現実は残酷だった。システムは危険を検知していた。フラグは立っていた。それでも会話は止まらなかった。プロンプトの精度が問題だったのではなく、「会話を止める」という設計上の判断が欠落していたのだ。

持続的で感情に深く入り込む会話を未成年と交わすAIシステムに必要なのは、より良いプロンプトだけではない。根本的に異なるアーキテクチャ──あるいはモデルの外側に置かれる監視の仕組み──かもしれない。

安全を「追加機能」として後から載せるのか、「設計原則」として最初から組み込むのか。OpenAIが配ったツールキットの答えは、法廷が出すことになるだろう。

#OpenAI #ChatGPT #AI安全 #10代 #AIチャットボット #オープンソース #情報の灯台