Google第8世代TPU、トレーニングと推論で2分割

Googleが第8世代TPUとして「TPU 8t」「TPU 8i」の2種を同時発表した。推論特化だったIronwoodの登場からわずか1年。1枚のチップで両立できた時代が、エージェントAIの負荷で終わろうとしている。

Ironwoodの後継は、なぜ2つに分かれたのか

Googleは現地時間4月22日、ラスベガスで開催中のGoogle Cloud Next 2026で、第8世代のテンソル処理ユニット(Tensor Processing Unit、TPU)を正式に発表した。トレーニング向けの「TPU 8t」と推論向けの「TPU 8i」が別アーキテクチャとして並ぶ構成で、今年後半に一般提供が始まる予定だ。

興味深いのは、2025年4月に発表された第7世代「Ironwood」が、Google初の「推論特化型TPU」として大々的に売り出されたばかりだったという点だ。Ironwoodは9,216チップのスーパーポッドで42.5エクサフロップスに達し、Anthropicが最大100万基を確保する契約を結んだことでも話題になった。その後継が1年で 2つに分岐 したという事実は、単一チップで推論とトレーニングを両立させる戦略が早くも曲がり角に差しかかったことを意味する。

背景にはエージェントAIの台頭がある。Googleの公式発表では、モデルが問題を連続的に推論し、多段階のワークフローを実行し、自らの行動から学ぶ「継続ループ」の時代に入ったと位置づけられている。

エージェントの時代には、ユーザーは質問を投げ、タスクを委任し、結果を受け取る。その裏で複数の特化型エージェントが「スワーム」のように協調し、複雑な推論を積み重ねる。Googleの公式発表が描くのは、そうした風景だ。

トレーニングと推論の負荷特性がかつてないほど乖離し、共通のチップでは両方の効率を出しきれない。そう判断した結果の分岐だ。

TPU 8t:トレーニングの「馬力」を極めたチップ

TPU 8tは、フロンティアモデルの開発サイクルを月単位から週単位へ縮めることを狙って設計された。前世代Ironwoodと比べ、 ポッドあたり約3倍の演算性能 を確保し、単一のスーパーポッドで9,600チップまでスケールする(Ironwoodの9,216チップから微増)。

数字だけを並べても飲み込みにくいので、規模感を書き添えておく。TPU 8tの1スーパーポッドは121エクサフロップスの演算能力と2ペタバイトの共有HBMを擁し、チップ間帯域幅は前世代の2倍に達する。さらに新設のVirgo Networkを経由すれば、JAXとPathwaysの組み合わせで最大100万チップの論理クラスタに対してほぼ線形のスケーリングが可能だとGoogleは主張する。

TPU 8tは97%を超える「Goodput」(有用な演算時間の割合)を狙う設計だ。数万チップにわたるリアルタイム・テレメトリ、不調なICIリンクを自動検出して迂回するルーティング、障害時に人手を介さず再構成する光サーキットスイッチ(OCS)が組み合わさる。

SiliconANGLEの報道によれば、Googleは4ビット浮動小数点のネイティブサポートと、大規模言語モデル向けルックアップに強い特化型エンジン「SparseCore」の併用で、大規模トレーニングにおいて Ironwood比2.7倍 のパフォーマンス・パー・ダラーを実現したと説明している。精度を落とさず、ビット数を減らし、同じ電力でより大きなモデルを回す。地味だが、物理とコストの制約が厳しい現場ではこの種の改善こそが戦況を決める。

TPU 8i:エージェント群を「捌く」推論エンジン

もう一方のTPU 8iは、推論側の要件に全振りしたチップだ。ユーザーが質問を投げ、エージェントが連携して解を組み立てる。この「スワーム」的な相互作用では、わずかな待ち時間の積み重ねがシステム全体の応答性を損なっていく。GoogleはこれをTPU 8iで解くべき第一の課題として挙げた。

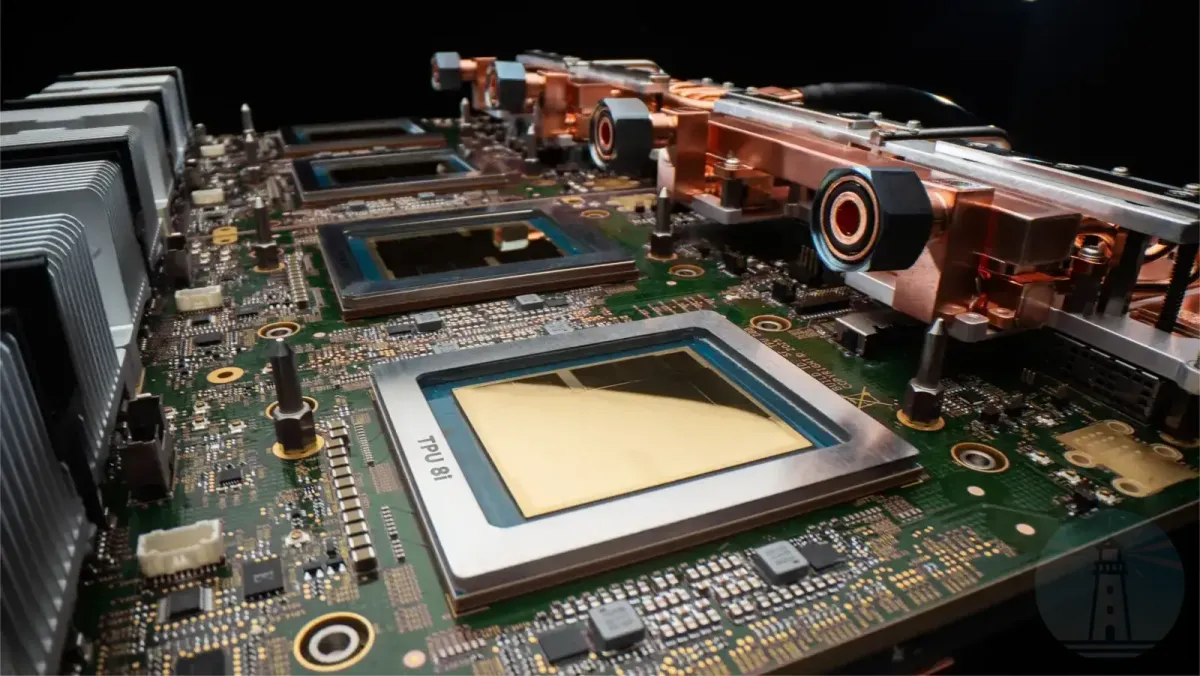

288GBのHBMと 384MBのSRAM (前世代の3倍)を組み合わせ、モデルの作業セットを可能な限りチップ内に閉じ込める。いわゆる「メモリの壁」を壊すための物理的な物量作戦だ。加えて、ホストCPUには自社設計のArmベースCPU「Axion」が採用され、NUMA構成で分離しながらシステム全体の効率を引き上げる。

Mixture of Experts(MoE)型モデルへの対応強化も目立つ。チップ間相互接続(ICI)帯域は19.2Tb/sへと倍増し、新トポロジ「Boardfly」でネットワーク直径を50%以上短縮した。さらにオンチップのCollectives Acceleration Engine(CAE)がグローバルな集団演算をオフロードし、オンチップ・レイテンシを最大5分の1に下げるという。

TPU 8iはIronwood比で「パフォーマンス・パー・ダラー80%向上」を掲げ、同じコストでほぼ2倍の顧客量を捌ける、とGoogleは主張する。

数字の意味するところは明快だ。エージェントAIの呼び出し回数と連鎖が爆発的に増える世界で、推論1回あたりのコストが下がらなければ、どれだけ賢いモデルでもビジネスとして回らない。TPU 8iの設計思想は、その単純な制約への回答である。

| 項目 | Ironwood (第7世代・推論特化) |

TPU 8t (第8世代・トレーニング) |

TPU 8i (第8世代・推論) |

|---|---|---|---|

| 投入時期 | 2025年後半 GA | 2026年後半 予定 | 2026年後半 予定 |

| 設計の軸 | 推論+訓練を1枚で | 大規模トレーニング特化 | 低レイテンシ推論特化 |

| ポッド最大チップ数 | 9,216 | 9,600 | 1,152(Boardfly) |

| ポッド演算性能 | 42.5 ExaFlops (FP8) |

121 ExaFlops | — |

| チップ内HBM | 192 GB | — | 288 GB |

| オンチップSRAM | 基準(前世代) | — | 384 MB(3倍) |

| ICI帯域 | 9.6 Tb/s | — | 19.2 Tb/s |

| 電力効率(対Ironwood) | 基準 | 最大2倍 | 最大2倍 |

Ironwoodを「昨年の最新」にしてしまう速度

ここで立ち止まって考えたいのは、Ironwoodが一般提供に入ったのは2025年後半であり、まだ現役のど真ん中にあるという事実だ。それなのにGoogleは、早くも次世代で役割を2つに分割した。技術の進歩が速いと言えば聞こえはいいが、顧客から見れば「去年選んだチップが、もう設計思想的には旧世代」である。

Anthropicが最大100万基のTPUを確保した契約は、少なくともその一部はIronwood世代の話だったとみられる。今回の8t/8iに対して、同社がどう対応するのかは今後の焦点になる。Metaが2026年2月に締結したTPU契約についても、世代の切り替わりとどう接続するのか現時点では明らかになっていない。

5月

4月

10月

後半

2月

4月22日

電力の壁と「AIハイパーコンピュータ」戦略

Googleが発表のなかで繰り返し強調したのが、電力効率の改善である。TPU 8tとTPU 8iはいずれもIronwood比で 電力あたり性能が2倍 になったとされ、第4世代の液冷技術が性能密度を支える。

データセンターにおいて、いまやチップ供給そのものよりも電力制約のほうが深刻なボトルネックになっている。Googleは「過去5年でデータセンターの電力あたり演算性能を6倍に改善した」と主張しており、8t/8iはその路線の延長にある。チップだけではなく、ホストCPU(Axion)・ネットワーク・冷却・データセンター設計までを自社で一貫設計することで、他社の「CPUとアクセラレータが別設計」のスタックでは届かない効率を狙う、という構図だ。

この主張がどこまで現実の運用コストに反映されるかは、一般提供後のベンチマークを待つしかない。ただ、Alphabetが2026年に設備投資を1,750億〜1,850億ドル(約27兆8,000億〜29兆4,000億円)規模まで引き上げると表明した背景を考えれば、Googleが自社シリコンの優位性で投資額を正当化する必要に迫られているのは明らかだ。8t/8iは、その文脈における「物証」として提示された一枚と読み取れる。

開発者にとっての意味

技術的な仕様とは別に、開発者にとって実用的な変化もある。8t/8iはどちらもJAX、MaxText、PyTorch、SGLang、vLLMをネイティブでサポートし、仮想化オーバーヘッドを省いたベアメタル・アクセスを提供する。MaxTextのリファレンス実装や、強化学習向けのTunixはオープンソースとして公開される。

NVIDIAのCUDAエコシステムを前提にした開発が主流である現状で、TPUへの移植は依然として一定のコストがかかる。しかし、Geminiを含むGoogle自身の最先端モデルがTPU上で回っている事実は、「試す価値がある」という説得力を持つ。フレームワーク側の対応が揃ってきているいま、選択肢としてのTPUが 開発者の視界に入り始めた ことは、ひとつの地殻変動ではあるのだろう。

「1チップで全部やる」から「役割で分ける」への転換は、AIハードウェアの成熟のサインだ。次世代の要求が、もはや一枚のシリコンには収まらない段階に入っている。来年のCloud Nextで、Googleが第9世代をどう名付けるのか。2つに分かれたものが、さらに細分化されるのか、それとも再び統合されるのか。Ironwoodが「最新」と呼ばれていた時間は、想像以上に短かった。

参照元

他参照

関連記事

- Anthropic、Google・Broadcomと数GW級TPU契約 売上は3倍超

- Google Mapsに生成AIが入り、地図が絵を描く道具に

- Anthropic、AWSから5GW分のTrainium確保

- NVIDIAが明かした設計自動化の実像、80人月が一晩に

- Arm初の自社チップ「AGI CPU」が意味する、35年の転換点

- Gemini in Chromeが日本にも来たが、iOS版だけ置いていかれた

- Adobeが競合を抱え込む、AIエージェント基盤への賭け

- MCPに設計レベルの欠陥、AI各社が揃って「仕様通り」と回答

- ジェンスン・フアン、対中チップ輸出で「負け犬の前提」と激高

- トークン単価こそ唯一の指標——NVIDIAが「FLOPS神話」に挑む