トークン単価こそ唯一の指標——NVIDIAが「FLOPS神話」に挑む

今まで通りの"安いGPU"選びが、AI事業を赤字化させる。NVIDIAが公式ブログで展開した主張の核心はそこにある。

今まで通りの"安いGPU"選びが、AI事業を赤字化させる。NVIDIAが公式ブログで展開した主張の核心はそこにある。

データセンターは「AIトークン工場」に変わった

従来のデータセンターは、データを蓄積・検索・処理する施設だった。生成AIとエージェントAI(agentic AI)の時代に入って、その役割は根本から変わっている。今の主要ワークロードはAI推論(インファレンス)であり、施設が生産するのは「トークン」という形の知性だ。

NVIDIAは4月15日の公式ブログで、この構造変化に伴いAIインフラのTCO(総所有コスト)の評価軸も変えるべきだと論じた。

データセンターはトークンを製造するAI工場へと進化した。出力で動くビジネスを、入力指標で最適化するのは根本的なミスマッチだ。

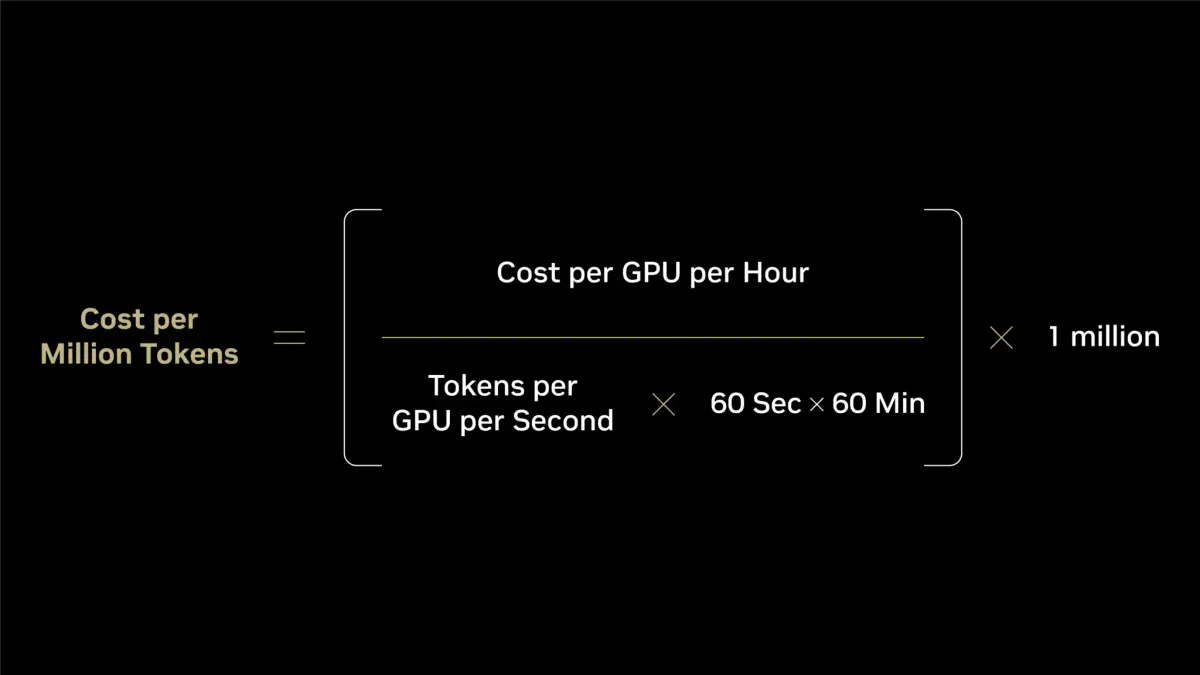

企業がいまだに使いがちな評価軸として、NVIDIAは3つを挙げる。GPU時間単価(クラウドやオンプレミスの稼働コスト)、FLOPSドル換算(1ドルで得られる演算性能)、そしてトークン単価(100万トークンあたりの実コスト)の3つだ。最初の2つは「投入指標」に過ぎない。

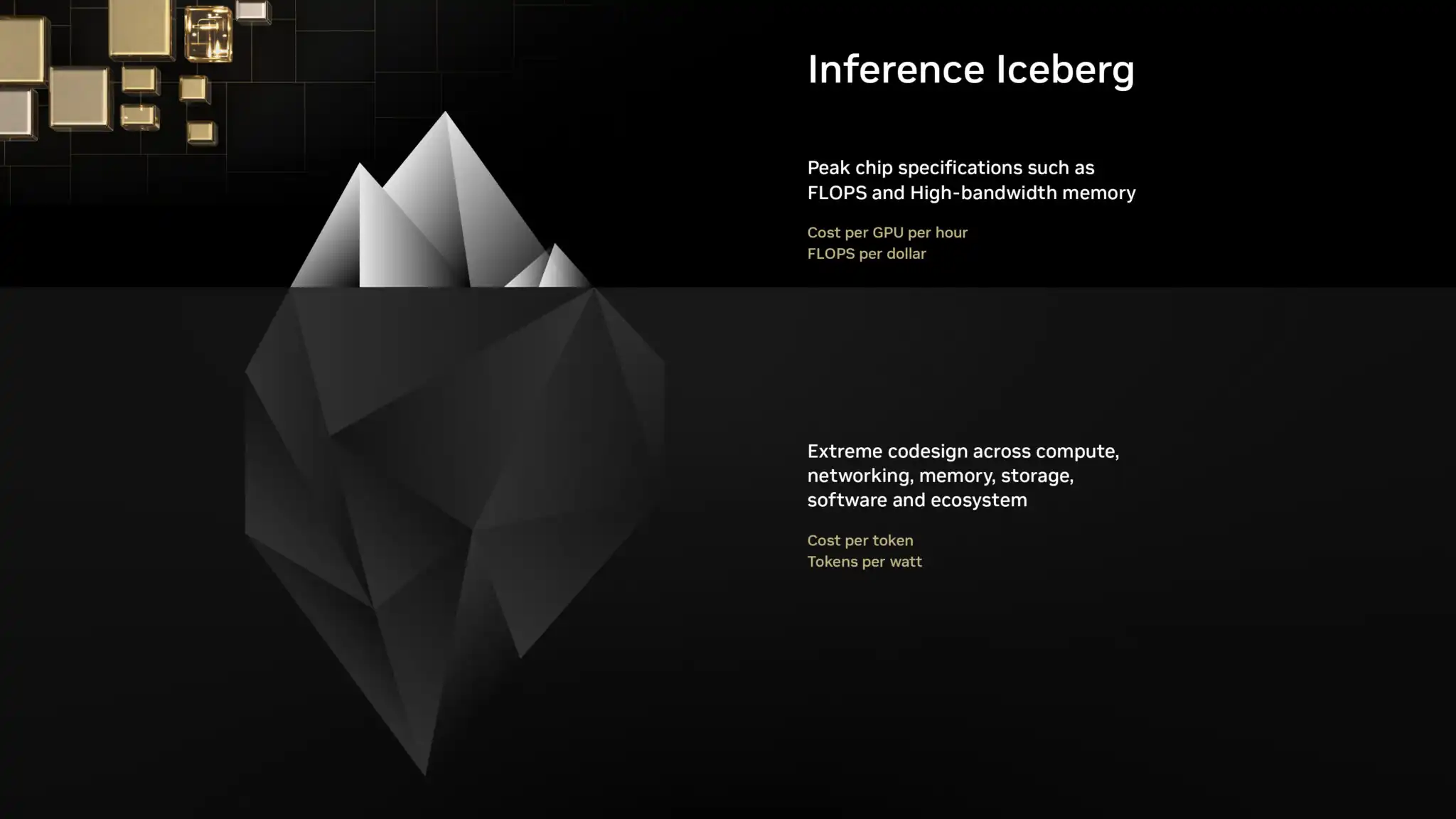

「推論の氷山」——表面に見えるものと水面下の現実

NVIDIAがこのブログで持ち出したのが「推論の氷山」という概念だ。

氷山の水面上に見えているのは、GPU時間単価やFLOPS数といった比較しやすいスペック。水面下に隠れているのは、実際のトークン出力量を左右するあらゆる要素——ネットワーク性能、FP4精度サポート、投機的デコーディング(speculative decoding)やKVキャッシュオフローディング、エージェントAIに求められる超低レイテンシ対応など——の積み重ねだ。

コスト2倍のGPUが100万トークン単価では35分の1を実現

問題は、水面上だけを見て「安い」と判断したGPUが、水面下の最適化不足から実際のトークン生産量で大幅に劣ることがある点だ。

BlackwellはHopperより高い、でもトークン単価は35分の1

NVIDIAのブログが提示した数字は、その乖離を具体的に示している。DeepSeek-R1モデルで比較した場合、GPU時間単価はBlackwell(GB300 NVL72)が1時間2.65ドルでHopper(HGX H200)の1.41ドルのおよそ 2倍 だ。FLOPSドル換算でも2倍の差に留まる。

ところが実際の出力を見ると話が変わる。

1秒あたりのトークン生成数はHopperの90トークン/GPUに対し、Blackwellは6,000トークン/GPUと 65倍 の差がある。電力消費1メガワットあたりのトークン出力は50倍。その結果、100万トークンあたりのコストはHopperの4.20ドルから0.12ドルまで落ちる——つまり 35分の1 だ。

| 指標 | Hopper HGX H200 |

Blackwell GB300 NVL72 |

Blackwellの倍率 |

|---|---|---|---|

| GPU時間単価 | $1.41 | $2.65 | |

| FLOPSドル換算 | 2.8 PFLOPS | 5.6 PFLOPS | |

| トークン/秒/GPU | 90 | 6,000 | |

| トークン/秒/MW | 54,000 | 2.8M | |

| 100万トークン単価 | $4.20 | $0.12 |

数字だけ見れば「2倍高いGPU」でも、出力で割ると35分の1に化ける。コスト比較の基準点をどこに置くかで、意思決定が180度変わるという論点だ。

Blackwellの場合、DeepSeek-R1での100万トークンあたりのコストは0.12ドル。Hopperの4.20ドルから35分の1まで下がっている。(NVIDIAとSemiAnalysis InferenceX v2ベンチマークによるデータ)

「ベンダーが提案する指標には警戒が必要」——アナリストの留保

もっとも、この主張をそのまま受け取るべきかは別の話だ。

Moor Insights & Strategyのシニアデータセンターアナリスト、マット・キンボール(Matt Kimball)はData Center Knowledgeの取材に対し、「ベンダーが成功の定義を自ら提唱するとき、当然の懐疑心が生まれる」と指摘した。

トークン経済学——つまりトークン単価——はNVIDIAに有利な指標だ。同社はシリコンからソフトウェアまでシステム全体を握っており、その定義を押し出すことには明らかな理由がある。

キンボールはNVIDIAがフルスタックプロバイダーとしてハードとソフト両面で性能向上を積み上げられる点は認めつつも、率直にこう述べた。「この指標を企業ITの成功基準として受け入れるのは時期尚早だ。完全に理解するまでには少なくとも2年はかかる」と。さらに、トークン単価が最良でも、ユーザーが遅すぎる・精度が低いと感じれば意味がないとも付け加えた。

また別の批評として、「トークンを安く生産することと、それが企業の収益創出に直結するかどうかは別問題」という指摘もある。生産コストの低下が自動的に有益な製品や顧客収益に結びつくわけではない、という現実だ。

指標の選択が、インフラ投資の命運を分ける

NVIDIAの主張の骨格自体は筋が通っている。同じ電力予算の中でどれだけのトークンを生産できるかが、AIサービスの収益性を規定するというロジックは、クラウドプロバイダーや大規模インフラ運営者にとって実用的な評価軸だ。

CoreWeave、Nebius、Together AIといったパートナー各社がBlackwellインフラを導入し、本番環境でそのコスト優位性を確認していることも、単なる机上の計算ではないことを示している。

一方で、スタートアップや中小規模の企業にとっては、初期投資コストや自社ワークロードの特性、ベンダー依存リスクなども含めた多角的な評価が引き続き必要だ。「トークン単価最強」の一点だけで巨額のインフラ投資を正当化するのは、別の意味での「入力指標への過剰最適化」になりうる。

指標の選び方が投資判断を変える——NVIDIAが言いたいのはその通りだが、どの指標を使うかの選択にもまた、設計者の意図が宿っていることを忘れない方がいい。

参照元

他参照

#AI #GPU #データセンター #NVIDIA #NVIDIA Blackwell #インフラ #生成AI #機械学習 #クラウド #DeepSeek

@NVIDIAがAIインフラの評価指標をFLOPSドル換算からトークン単価へ転換すべきと公式に主張した。DeepSeek-R1ベンチマークでGPU時間単価が2倍のBlackwellがHopperに対してトークン生成量65倍、100万トークンコスト35分の1を実現と示す。「その指標はNVIDIAに有利な設計」というアナリストの留保も含め、指標の選択自体に設計者の意図が宿ることを示す事例だ。

関連記事

- AWS中東リージョン「完全ダウン」──Amazon社内文書で判明

- NVIDIA保証クレーム11倍、AIバブルの請求書が届いた

- NVIDIAが明かした設計自動化の実像、80人月が一晩に

- 3万ドルのAI用GPUが約40万円のRTX 5090に惨敗する理由

- Amazon独自チップ年間200億ドル、ジャシーが示した31兆円投資の根拠

- Anthropic、Google・Broadcomと数GW級TPU契約 売上は3倍超

- NVIDIA Pascal 10周年──黄金時代はどこへ

- ジェンスン・フアン、対中チップ輸出で「負け犬の前提」と激高

- Azure UK容量逼迫、顧客にスウェーデン移転を提案する事態

- NVIDIA、GTC Taipei 2026基調講演を6月1日開催と発表