GIGABYTE T-Guard投入、16ピン問題で4社目の実装

GIGABYTEが新型Gaming Series電源にT-Guardという温度監視機能を搭載した。MSI、ASUS、ASRockに続く4社目。PSU業界全体が16ピン問題を個別に吸収し始めた構図が見えてきた。

GIGABYTEが新型Gaming Series電源にT-Guardという温度監視機能を搭載した。MSI、ASUS、ASRockに続く4社目。PSU業界全体が16ピン問題を個別に吸収し始めた構図が見えてきた。

T-Guardは「システム全体を落とさない」思想で作られている

GIGABYTEは新型Gaming Series電源にT-Guardを搭載し、12V-2×6コネクタの安全対策でPSUベンダー4社目として動き出している。狙いは明快で、GPUが焼けるのをPSU側で食い止めることだ。

仕組みは、12V-2×6コネクタ内部に精密サーミスタ(NTC)を配置し、ケーブル温度をリアルタイムで監視する。異常温度を検知した時、システム全体をシャットダウンするのではなく、ディスクリートGPUへの電力供給だけを下げる。PCの残りの部分は動き続けるため、ユーザーは作業を保存して安全にシャットダウンする時間を得られる。iGPUが利用できるCPUを使っていれば、マザーボードのディスプレイ出力に切り替えて画面も復帰できる。

公式の説明動画では、これを「GPU保護への二層アプローチ」と呼んでいる。リアルタイムのコネクタ監視と、GPUだけを対象にした電力制御。ソフトウェアのインストールも設定も不要で、PSU内部で全てが完結する。

搭載モデルはGaming 1000GM PG5、850GM PG5、750GM PG5の3シリーズで、それぞれBlackとICEの2カラーが用意される。Cybenetics ETA PlatinumとLAMBDA A+認証を取得しており、効率と静音性も同時に狙っている。2色のケーブル設計で挿し込みの甘さを目視確認できるようにし、10年保証を付けた。

なぜこれが必要になったのか

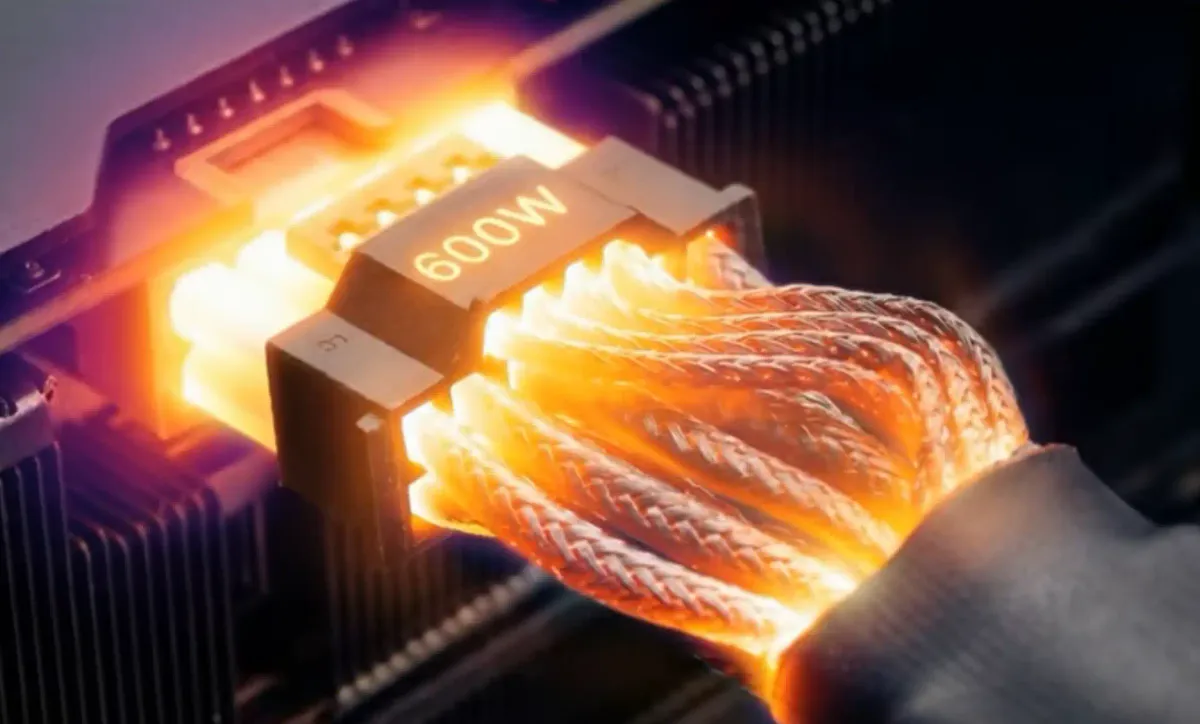

NVIDIAの16ピンコネクタ──初期の12VHPWR、現在の12V-2×6──は、RTX 40シリーズの登場以来、溶解事故の報道が絶えなかった。ハイエンドGPUが単一コネクタで600W近くを引き込む構造そのものが、接触抵抗のわずかな偏りから発熱を生み、時に樹脂を溶かす。RTX 5090では575Wという公式TGPが設定され、問題は収束するどころか拡大した。

GIGABYTE自身、挿し込み不完全、プラグ付近の鋭い曲げ、サードパーティのアダプタ、長期間の熱疲労が全て ホットスポット を生み得ると認めている。600Wを16ピンで流すという設計判断がそもそもマージンを食い潰しており、PSUベンダーはもうコネクタの安全を「一度限りの懸念」として扱えなくなっている。

VideoCardzが皮肉まじりに書いているのは、まさにこの点だ。なぜ業界全体がコネクタ保護機能を競って実装しなければならない状況になったのか──その前提自体が問われている。

ここで立ち止まって考えるべきは、問題の根本がどこにあるかだ。各PSUベンダーが保護機構を開発するコストは最終的に価格に跳ね返る。本来ならコネクタ仕様の時点で解決されているべき問題を、下流のベンダーが個別に吸収している。

各社の実装は思想が分かれている

興味深いのは、MSI、ASUS、ASRock、GIGABYTE、そしてCorsairが全て「12V-2×6をなんとかしたい」と考えているのに、アプローチが揃っていないことだ。

MSIのGPU Safeguard+は、シャント抵抗を使ってピン単位で電流を監視する。電流の偏りを検出すると警告を出し、MSI AfterburnerやMSI Center経由でGPUを絞る。ソフトウェアが介在する層を持っているのが特徴だ。

ASUSのROG Equalizerは、そもそもケーブル設計で電流を均等化しようとする。エッチング加工したケーブルで各ワイヤの抵抗を揃え、1本あたりの電流容量を9.2Aから17Aへ引き上げた。ASUSの極端試験では、+12V側の中4本を抜いた状態でROG Equalizerは約73.4℃、標準ケーブルは約146℃に達したという。

ただしこれはASUSのラボ条件下で中4本を抜いて故意に電流偏りを作った数値であり、通常使用の温度差を示すものではない。240時間の600W負荷試験(周囲温度55℃)で105℃上限を下回ったという数値も合わせて公表されている。

ASRockのTempGuardは、GIGABYTEに最も近い。VGA側コネクタにNTCセンサーを埋め込み、温度をPSUに伝える。対応PSU(Taichi/Phantom Gaming)と組み合わせた時のみ機能する点も同じだ。シャントMOD済みのRTX 5090を1350W引き込んだ事例で、ASRockのサーミスタが作動してシャットダウンに至り、コネクタの完全溶解を防いだ報告がある。

GIGABYTEの T-Guard はASRockの思想に近い実装と言える。温度センサーをケーブル側に置き、PSU側で判断する。ソフトウェアを挟まず、ハードウェアだけで完結する。

| 項目 | GIGABYTE T-Guard |

MSI GPU Safeguard+ |

ASUS ROG Equalizer |

ASRock TempGuard |

|---|---|---|---|---|

| ケーブル温度センサー | ○ | × | × | ○ |

| 電流・負荷監視 | × | ○ | × | × |

| ケーブル設計で均等化 | × | × | ○ | × |

| 異常時の動作 | GPUのみ 出力抑制 |

警告後 GPU出力抑制 |

ハード 負荷分散 |

PSU シャットダウン |

| ソフトウェア要否 | 不要 | 必要 (Afterburner等) |

不要 | 不要 |

| 他社PSUでの動作 | 非対応 | 非対応 | 対応 | 非対応 |

そしてCorsairも次世代PSUで ピン単位監視 を準備していると、同社のJonny "Guru" Gerow氏がRedditで明かした。製品名も投入時期も未発表だが、MSI方式に近い電流監視型になる可能性が高い。

全員が同じ方向に歩いている

ここで見えてくるのは、実装は違えど方向は一致しているという事実だ。MSI、GIGABYTE、ASRockは温度か電流かの違いはあれど「コネクタレベルの異常を検知する」点で共通している。ASUSは「そもそも異常を起こさせない」ケーブル設計で対抗する。Corsairも同じ土俵に登ろうとしている。

別の見方をすれば、PSUベンダーが全員「GPUとPSUの間にある一本のケーブルを、もう放置できない」と判断したことになる。数百万本の12V-2×6ケーブルが出荷されているうち、実際に溶解事故を起こしているのは統計的にはごく一部だ。しかしRTX 4090やRTX 5090のように1枚30万円を超えるGPUが焼け落ちる映像は、SNSで何度も共有される。ベンダーにとっては、確率の問題ではなく ブランドリスク の問題になっている。

構造を直す責任はどこにあるか

T-Guardは賢い設計だ。ハードウェアだけで完結し、ソフトウェアを必要とせず、システム全体を落とさずGPUだけを守る。ユーザー体験としては理想に近い。Gigabyteの過去の電源──Gamers NexusやTechPowerUpが爆発報告した旧世代P750/850GM──の悪評を踏まえると、同社が安全機能で攻める方向に振ったこと自体は理にかなっている。

要するに、12V-2×6がこれだけ普及してしまった今、仕様を巻き戻すのは現実的ではない。PSUベンダーが下流で吸収する構図は、理想ではないが現実的な落としどころだ。T-Guardはその現実への賢い適応と見ることもできる。

だが、それでも引っかかるのは、この機能が「あるべき」なのか「あるべきではない」のかという問いだ。NVIDIAがコネクタ仕様の時点で適切なマージンを確保していれば、PSUベンダーがそれぞれ独自のサーミスタやシャント抵抗を仕込む必要はなかった。YouTubeのコメント欄でも「NVIDIAがコネクタを直せば済む話」「存在すべきではない問題の解決策だ」という声が多い。

PSU業界が連鎖的にコネクタ保護に動いている──この事実そのものが、問題の所在を指し示している。

参照元

他参照

- ASUS ROG - ROG Equalizer製品ページ

- VideoCardz - GIGABYTE also wants to protect 12V-2×6 GPUs from burning with T-Guard

関連記事

- ROG Equalizer初の実機レビュー、16pin温度が9℃低下

- ASUSが「ROG Equalizer」発表、16ピンの焼損対策を自前で

- RTX 4090が燃え始めた。飼い主を救ったのはハードウェア監視ではなく「猫」だった

- MacでNVIDIA復活、TinyGPUドライバの実力と現実

- DLSS Enablerがx5/x6解放、RTX 40も対象

- RTX 5060 Ti/5060に9GB版の噂、帯域幅は25%削減へ

- RX 9070 XTコネクタ焼損9件目、全て同じ青アダプター

- 3万ドルのAI用GPUが約40万円のRTX 5090に惨敗する理由

- ASUSもHUDIMMに追従、独自規格が業界標準に化ける兆し

- ジェンスン・フアン、対中チップ輸出で「負け犬の前提」と激高